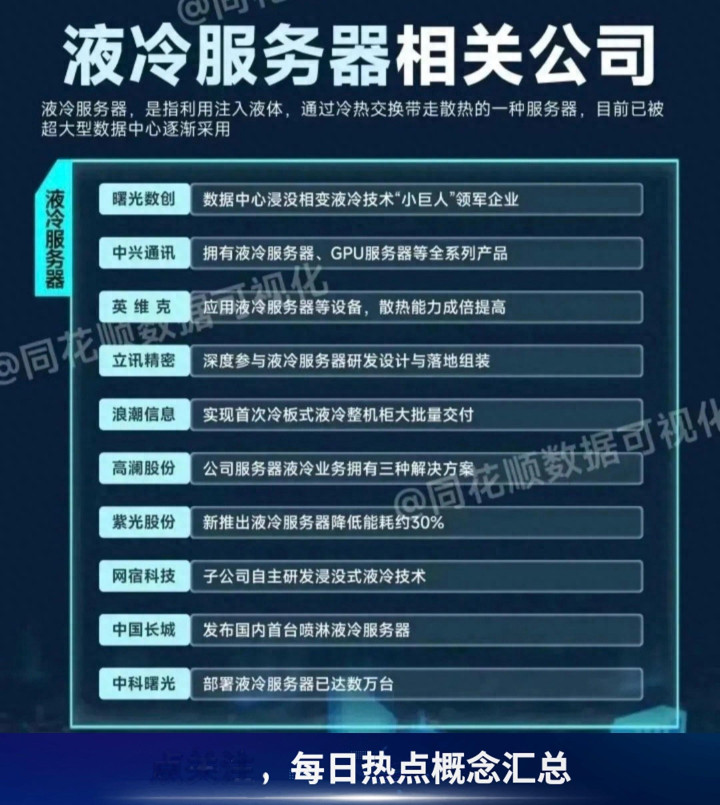

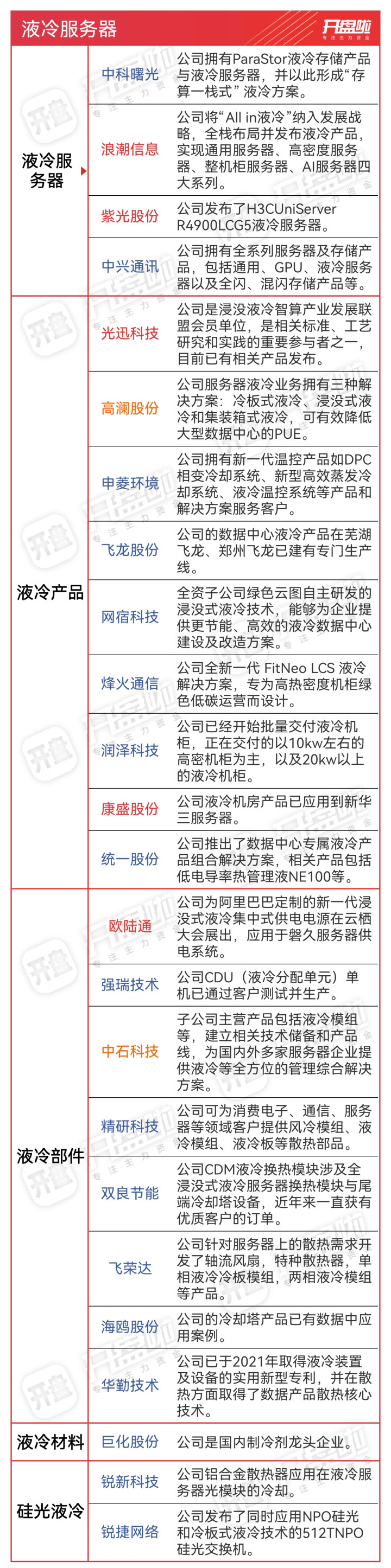

转存! 液冷服务器概念股汇总。2026年液冷市场规模达180亿元

预计到2026年,谷歌服务器液冷市场规模将攀升至约180亿元,这一数字背后是AI算力爆发与芯片功耗激增的双重驱动。随着谷歌TPU等AI芯片单卡功耗突破千瓦级,传统风冷技术已无法满足散热需求,液冷技术凭借高效散热、低能耗等优势,成为高密度算力中心的核心解决方案。

芯片功耗的持续攀升是液冷需求激增的直接原因。以谷歌TPU系列为例,其最新一代芯片单卡功耗已达980W,逼近风冷散热的物理极限。若采用风冷方案,需部署大量风扇并提高转速,但这不仅会显著增加噪音(机房噪音可达80分贝以上),还会导致局部热点问题,影响芯片稳定性。相比之下,液冷通过循环冷却液直接带走热量,可将芯片温度控制在安全范围内,同时降低噪音至30分贝以下。更关键的是,随着芯片制程逼近物理极限,未来单卡功耗可能突破1200W,届时风冷将完全失效,液冷将成为唯一可行方案。

AI算力的指数级扩张进一步放大了液冷需求。谷歌2026年计划将TPU机柜出货量提升至6.5万柜,较2025年增长近一倍。以单柜搭载8张TPU v7计算,总功耗将超过500MW,相当于一座小型火电站的发电量。若采用风冷方案,需配套建设庞大的空调系统,不仅占用大量机房空间,还会导致PUE(能效比)飙升至1.8以上。而液冷方案可将PUE控制在1.2以下,单柜年节电量超过20万度,相当于减少120吨二氧化碳排放。此外,液冷还能提升算力密度,单柜可支持更多芯片并行计算,从而降低单位算力成本,这对谷歌等追求极致效率的科技巨头而言至关重要。

北美地区因电力短缺已多次推迟数据中心建设项目,而液冷技术可降低30%以上的能耗,成为缓解缺电问题的关键手段。例如,谷歌在爱荷华州的数据中心采用液冷方案后,单机柜功耗从40kW提升至100kW,但总用电量仅增加15%,成功规避了当地电力配额限制。与此同时,欧盟《绿色数据中心指令》要求2030年数据中心PUE降至1.3以下,液冷技术成为达标的核心路径。在中国,工信部等六部门联合发布的《算力基础设施高质量发展行动计划》也明确鼓励采用液冷等节能技术,推动数据中心向绿色低碳转型。

CDU(冷量分配单元)作为液冷系统的“心脏”,其核心作用之一是精准调控冷却液流量。在数据中心中,单台CDU需同时为数百个液冷板供液,若流量分配不均,会导致部分芯片过热而另一些区域冷却液浪费。谷歌采用的智能CDU通过内置传感器实时监测各液冷板温度,并动态调整阀门开度,确保冷却液流量与芯片功耗精准匹配。例如,当某块TPU进入高负载运算时,CDU会立即增加该区域供液量,同时减少低负载区域的流量,实现“按需分配”。这种精准调控不仅提升了散热效率,还降低了冷却液消耗量,单柜年节省冷却液成本可达数万元。

液冷系统中,冷却液的温度、压力、电导率等参数需严格控制在安全范围内,否则可能引发短路或腐蚀问题。CDU集成了多重安全防护机制:通过温度传感器实时监测冷却液温度,若超过阈值会自动启动备用冷却回路;采用压力调节阀维持系统压力稳定,防止因压力波动导致液冷板变形;内置电导率监测模块,一旦检测到冷却液电导率异常(如因杂质混入导致导电性增强),会立即触发报警并隔离故障区域。这些措施使得液冷系统的故障率降至0.1%以下。

传统液冷方案中,冷却液在循环过程中会因摩擦、阀门阻力等因素产生能量损耗,导致泵功消耗增加。通过优化CDU内部流道设计,将冷却液流动阻力降低40%,同时采用变频泵技术,根据实际需求动态调整泵速。例如,在低负载时段,CDU会将泵速降至30%,单柜年节电量超过5000度。此外,将CDU与余热回收系统结合,将冷却液携带的热量用于数据中心周边建筑供暖,实现能源梯级利用。据测算,这种“热电联产”模式可使数据中心整体能效提升15%,进一步降低运营成本。

http://tqr.985link.com/qrewomfkvla/3319411.html